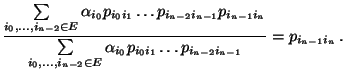

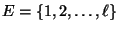

- Den Ausgangspunkt bildet die (endliche) Menge aller möglichen

Zustände, die Zustandsraum der Markov-Kette genannt wird und

die o.B.d.A. mit der Menge

identifiziert

werden kann, wobei

identifiziert

werden kann, wobei

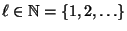

eine beliebige,

jedoch fest vorgegebene natürliche Zahl ist.

eine beliebige,

jedoch fest vorgegebene natürliche Zahl ist.

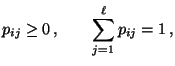

- Für jedes

sei

sei  die Wahrscheinlichkeit, dass

sich das betrachtete Objekt, Sachverhalt bzw. System zum

,,Zeitpunkt''

die Wahrscheinlichkeit, dass

sich das betrachtete Objekt, Sachverhalt bzw. System zum

,,Zeitpunkt''  im Zustand

im Zustand  befindet, wobei

befindet, wobei

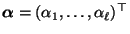

vorausgesetzt wird. Der Vektor der (Einzel-)

Wahrscheinlichkeiten

der (Einzel-)

Wahrscheinlichkeiten

bildet die Anfangsverteilung der Markov-Kette.

bildet die Anfangsverteilung der Markov-Kette.

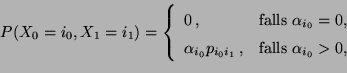

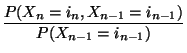

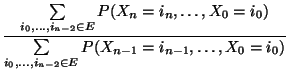

- Außerdem betrachten wir für jedes Paar

die (bedingte)

Wahrscheinlichkeit

die (bedingte)

Wahrscheinlichkeit

![$ p_{ij}\in[0,1]$](img26.png) , dass das betrachtete Objekt,

Sachverhalt bzw. System in einem Schritt aus dem Zustand

, dass das betrachtete Objekt,

Sachverhalt bzw. System in einem Schritt aus dem Zustand  in

den Zustand

in

den Zustand  übergeht.

übergeht.

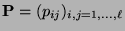

- Die

Matrix

Matrix

der Übergangswahrscheinlichkeiten

der Übergangswahrscheinlichkeiten  mit

mit

heißt (einstufige) Übergangsmatrix der Markov-Kette.

![$\displaystyle \alpha_i\in[0,1]\,,\qquad\sum\limits_{i=1}^\ell \alpha_i=1$](img22.png)